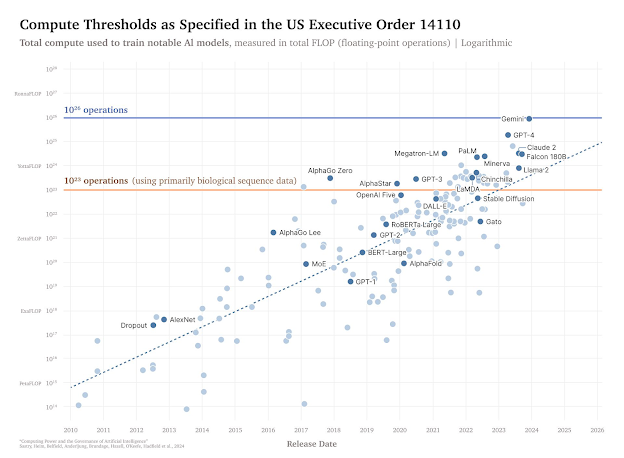

J'ai fait un post précédemment dans mon blog post précédemment dans mon blog sur la puissance de calcul nécessaire pour l'IA. Les calculs de formations pour générer les LLM ont doublé tous les 6 mois depuis l'émergence de l'ère du Deep Learning. On trouve de nombreux modèles ayant demandé plus de 10Exp23 Flops.

Le premier modèle formé sur plus de 10^23 FLOP, AlphaGo Master, a été publié en 2017, mais la grande majorité des modèles gourmands en calcul ont été publiés après 2021.

Même si le coût du Flops à fortement diminué pour atteindre aujourd'hui 0.01$

les volumes de calcul nécessaires nécessitent des investissement financiers conséquents:

GPT-4 d'OpenAI a couté environ 78 M$ pour l'entraînement de son LLM ,

tandis que le Gemini Ultra de Google a coûté 191 M$ (source)

Mais pour quels domaines sont générés ces modèles ?

Grâce aux recherches d'Epoch, 81 modèles ont été identifiés au-dessus de ce seuil, 10exp23 et 86 autres qui, selon eux, dépassent probablement ce seuil, mais ne disposent pas de détails de formation accessibles au public.

La plupart des modèles gourmands en calcul sont des modèles de langage, comme on pouvait s'y attendre. Les plus grands modèles de notre ensemble de données, GPT-4 et Gemini Ultra, sont tous deux des modèles de langage de vision multimodaux. Après avoir exclu la langue, le principal autre domaine était la génération de vidéos/images.

La plupart des modèles gourmands en calcul sont des modèles de langage, comme on pouvait s'y attendre. Les plus grands modèles de notre ensemble de données, GPT-4 et Gemini Ultra, sont tous deux des modèles de langage de vision multimodaux. Après avoir exclu la langue, le principal autre domaine était la génération de vidéos/images.

43 des 81 modèles à forte intensité de calcul ont été développés par des organisations basées aux États-Unis, suivies de 19 en Chine et de 6 au Royaume-Uni. La proportion provenant de la Chine a augmenté ces dernières années.

Les principaux développeurs de modèles confirmés à forte intensité de calcul sont Google, Meta, DeepMind, Hugging Face et OpenAI. Si l’on inclut des modèles à forte intensité de calcul non confirmés, Anthropic et Alibaba se situent également en tête.

Sources :

Computing Power and gouvernance of Artificial Intelligence

https://arxiv.org/pdf/2402.08797

Fil twitter

https://x.com/EpochAIResearch/status/1776265242722324502

Les principaux développeurs de modèles confirmés à forte intensité de calcul sont Google, Meta, DeepMind, Hugging Face et OpenAI. Si l’on inclut des modèles à forte intensité de calcul non confirmés, Anthropic et Alibaba se situent également en tête.

Sources :

Computing Power and gouvernance of Artificial Intelligence

https://arxiv.org/pdf/2402.08797

Fil twitter

https://x.com/EpochAIResearch/status/1776265242722324502

Aucun commentaire:

Enregistrer un commentaire